线性模型

- 给定n维输入

- 线性模型有一个n维权重和一个标量偏差

- 输出是输入的加权和

向量版本:

线性模型可以看做是单层神经网络

衡量预估质量

- 比较真实值和预估值,比如房屋售价和估价

- 假设是真实值,是估计值,我们可以比较

这个叫做平方损失

训练数据

- 收集一些数据点来决定参数值(权重和偏差),例如过去六个月卖的房子

- 这被称之为训练数据,通常越多越好

- 假设我们有n个样本,记为

参数学习

- 训练损失

- 最小化损失来学习参数

显示解

- 将偏差加入权重

- 损失是凸函数,所以最优解满足

基础优化算法

梯度下降

- 挑选一个初始值

- 重复迭代参数t=1,2,3

- 沿梯度方向将增加损失函数值

- 学习率:步长的超参数,人为指定的值

- 不能选太小(计算梯度成本昂贵),也不能太大

小批量随机梯度下降

- 在整个训练集上算梯度太贵

- 一个神经网络模型可能需要数分钟至数小时

- 我们可以随机采样b个样本来近似损失

- b是批量大小,另一个重要的超参数,不能太小(每次计算量太小,不适合并行来最大利用计算资源),也不能太大(内存消耗增加,浪费计算)

线性回归从零开始实现

%matplotlib inlineJupyter Notebook的魔法命令,让matplotlib绘制的图直接嵌入到Notebook单元格里,方便查看可视化效果

import torch

def synthetic_data(w, b, num_examples):

"""生成 y = Xw + b + 噪声。"""

X = torch.normal(0, 1, (num_examples, len(w)))

y = torch.matmul(X, w) + b

y += torch.normal(0, 0.01, y.shape)

return X, y.reshape((-1, 1))

true_w = torch.tensor([2, -3.4])

true_b = 4.2

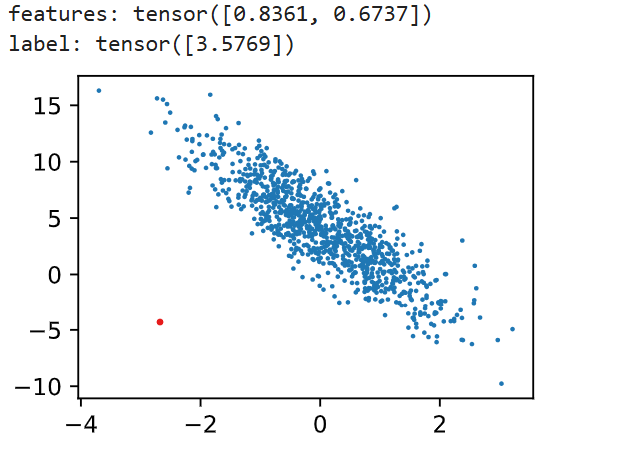

features, labels = synthetic_data(true_w, true_b, 1000)根据带有噪声的线性模型构造一个人工数据集。我们使用线性模型参数和噪声项生成数据集标签:

num_examples是要生成的样本数量torch.normal()函数用于生成服从正态分布(均值为0,标准差为1)的张量, 生成的张量形状为(num_examples,len(w))torch.matmul()函数用于计算矩阵乘法- 再用

torch.normal()函数生成一个与形状相同的张量,模拟真实数据中存在的噪声干扰 reshape(-1,1),-1表示自动计算该维度的大小,这里就是把调整为列向量形式(每个样本对应一个标签值,竖排)

print('features:', features[0],'\nlabel:', labels[0])

d2l.set_figsize()

d2l.plt.scatter(features[:, 1].detach().numpy(),

labels.detach().numpy(), 1);

features[:,1]选取特征矩阵的全部行和第一列,用于作为散点图的横坐标数据detach()用于分理出不需要计算梯度的部分,numpy()用于将张量转换为numpy数组,这样matplotlib才能绘图处理数据- 最后的1表示散点的大小

def data_iter(batch_size, features, labels):

num_examples = len(features)

indices = list(range(num_examples))

# 这些样本是随机读取的,没有特定的顺序

random.shuffle(indices)

for i in range(0, num_examples, batch_size):

batch_indices = torch.tensor(

indices[i:min(i + batch_size, num_examples)]

)

yield features[batch_indices], labels[batch_indices]

batch_size = 10定义一个data_iter()函数,该函数接受批量大小、特征矩阵和标签向量作为输入,生成大小为batch_size的小批量,用于后续学习训练时按批次喂入

range(num_examples)生成从0到num_examples-1的整数序列,list函数将其转换为列表indices,存储了所有样本的索引- 调用

random库的shuffle函数,将indices列表打乱顺序 range函数的三个参数分别表示起始值、结束值和步长- 使用

yield关键字,将特征矩阵features和标签向量labels按照batch_indices来选取对应的数据

for X, y in data_iter(batch_size, features, labels):

print(X, '\n', y)

breaktensor([[-1.7636, 0.8131],

[-1.1090, -0.1078],

[ 1.6120, 0.9181],

[-0.8033, 1.0371],

[ 1.8760, -1.7128],

[ 0.5852, -0.5707],

[ 1.3522, -0.5764],

[-0.0135, 1.7779],

[-0.9822, 0.2218],

[ 0.2937, -0.8818]])

tensor([[-2.0831],

[ 2.3468],

[ 4.3073],

[-0.9472],

[13.7802],

[ 7.2966],

[ 8.8604],

[-1.8829],

[ 1.4912],

[ 7.7952]])w = torch.normal(0,0.01,size=(2,1),requires_grad=True)

b = torch.zeros(1,requires_grad=True)

def linreg(X,w,b):

return torch.matmul(X,w) + b

def squared_loss(y_hat,y):

return (y_hat - y.reshape(y_hat.shape))**2/2

def sgd(params,lr,batch_size):

with torch.no_grad():

for param in params:

param -= lr*param.grad / batch_size

param.grad.zero_()- 首先初始化模型参数,然后定义线性模型,定义损失函数,定义随机梯度下降(SGD)优化逻辑

sgd函数要给定所有的参数,在这里param包含了w和b,然后是学习率,最后是批量大小with torch.no_grad():更新参数时,临时关闭自动求导param -= lr*param.grad / batch_size按公式更新参数,lr是学习率,param.grad是参数的梯度param.grad.zero_()更新完参数后,清空梯度,否则下次反向传播会累积梯度,导致计算错误

lr = 0.03

num_epochs = 3

net = linreg

loss = squared_loss

for epoch in range(num_epochs):

for X, y in data_iter(batch_size, features, labels):

l = loss(net(X, w, b), y) # `X`和`y`的小批量损失

# 因为`l`形状是(`batch_size`,) ,而不是一个标量。`l`中的所有元素被加到一起以此计算关于`w`, `b`的梯度

l.sum().backward()

sgd([w, b], lr, batch_size) # 使用参数的梯度更新参数

with torch.no_grad():

train_l = loss(net(features, w, b), labels)

print(f'epoch {epoch + 1}, loss {float(train_l.mean()):f}')epoch 1, loss 0.038667

epoch 2, loss 0.000139

epoch 3, loss 0.000046- 学习率

lr控制参数更新的步长,学习率是梯度下降的关键超参数,如果太大,参数更新可能会跨过最优解,模型不收敛;如果太小,训练会特别慢 - 设置训练轮数

num_epochs,一个Epoch意味着把所有训练数据都过一遍,更新一捆参数,这里只训练三轮,是为了演示流程 net = linreg指定了模型的前向计算函数,后续就可以用net(features, w, b)简洁调用线性回归的预测逻辑- 然后是定义损失函数

- 外层循环是训练轮次控制,内层循环是小批量数据遍历和单次数据更新

l = loss(net(X, w, b), y)计算当前小批量的损失,先调用net(X,w,b),即linreg(X,w,b),用当前的w和b对小批量特征X做预测,得到y_hat(预测值) 接着把y_hat和y传入loss函数,计算出这一批数据的损失l.sum().backward()反向传播计算梯度,为参数更新做准备,计算l对w和b的梯度,并把梯度值存到w.grad和b.grad中sgd([w, b], lr, batch_size)sgd是之前定义的函数

print(f'w的估计误差:{true_w - w.reshape(true_w.shape)}')

print(f'b的估计误差:{true_b - b}')- 比较真实参数和通过训练学到的参数来评估训练结果

w的估计误差:tensor([5.7220e-05, 3.7909e-05], grad_fn=<SubBackward0>)

b的估计误差:tensor([0.0011], grad_fn=<RsubBackward1>)线性回归的简洁实现

- 通过使用深度学习框架来简洁地实现线性回归模型 生成数据集

import numpy as np

import torch

from torch.utils import data

from d2l import torch as d2l

true_w = torch.tensor([2,-3.4])

true_b = 4.2

features,labels = d2l.synthetic_data(true_w,true_b,1000)features,labels = d2l.synthetic_data(true_w,true_b,1000)调用d2l库中synthetic_data函数生成模拟数据集,1000表示生成1000条数据样本

def load_array(data_arrays, batch_size, is_train=True):

"""构造一个PyTorch数据迭代器。"""

dataset = data.TensorDataset(*data_arrays)

return data.DataLoader(dataset, batch_size, shuffle=is_train)

batch_size = 10

data_iter = load_array((features, labels), batch_size)

"""数据加载器"""

next(iter(data_iter))load_array是一个自定义函数data_arrays是包含features和labels的可迭代对象,通过*data_arrays解包的方式穿入TensorDataset,通常是像(feature,label)这样的形式is_train是一个布尔值,用于决定数据是否进行打乱操作dataset = data.TensorDataset(*data_arrays)使用Pytorch的TensorDataset类,将传入的数据封装成一个数据集对象,它会把传入的张量按样本维度进行组合,方便后续按样本索引获取数据- 通过

DataLoader类,基于前面创建的dataset,设置每次加载的批次大小以及是否打乱 next(iter(data_iter))next函数获取这个迭代器的下一个元素,也就是下一批次的数据

from torch import nn

net = nn.Sequential(nn.Linear(2,1))

net[0].weight.data.normal_(0, 0.01)

net[0].bias.data.fill_(0)net = nn.Sequential(nn.Linear(2,1))用于定义神经网络,nn.Sequential是Pytorch中按顺序堆叠神经网络的容器,nn.Linear(2,1)是一个线性层,in_features = 2输入的特征向量维度为2,out_features = 1输出特征的维度是1,经过这个线性层计算后会输出一个一维的结果- 初始化模型参数,因为这个神经网络只有一个线性层,所以

net[0]就表示这个线性层,weight.data.normal_(0, 0.01)让权重参数从均值为1,标准差为0.01的正态分布中随机采样获取初始值,net[0].bias.data.fill_(0)线性层的偏置bias全部设置为0

loss = nn.MSELoss()

trainer = torch.optim.SGD(net.parameters(), lr=0.03)- 定义损失函数

- 定义

SGD优化器,torch.optim是Pytorch中用于优化算法的模块,传入的参数net.parameters()是之前定义的神经网络

num_epochs = 3

for epoch in range(num_epochs):

for X, y in data_iter:

l = loss(net(X), y)

trainer.zero_grad()

l.backward()

trainer.step()

l = loss(net(features), labels)

print(f'epoch {epoch + 1}, loss {l:f}')- 训练过程和之前十分类似,

trainer.zero_grad()Pytorch中的张量会默认累积梯度,所以在每次计算并更新新的梯度之前要把之前的梯度清零,trainer.step()更新参数

epoch 1, loss 0.000221

epoch 2, loss 0.000099

epoch 3, loss 0.000098